- русский

-

EnglishDeutschItaliaFrançais한국의русскийSvenskaNederlandespañolPortuguêspolski繁体中文SuomiGaeilgeSlovenskáSlovenijaČeštinaMelayuMagyarországHrvatskaDanskromânescIndonesiaΕλλάδαБългарски езикGalegolietuviųMaoriRepublika e ShqipërisëالعربيةአማርኛAzərbaycanEesti VabariikEuskeraБеларусьLëtzebuergeschAyitiAfrikaansBosnaíslenskaCambodiaမြန်မာМонголулсМакедонскиmalaɡasʲພາສາລາວKurdîსაქართველოIsiXhosaفارسیisiZuluPilipinoසිංහලTürk diliTiếng ViệtहिंदीТоҷикӣاردوภาษาไทยO'zbekKongeriketবাংলা ভাষারChicheŵaSamoa日本語SesothoCрпскиKiswahiliУкраїнаनेपालीעִבְרִיתپښتوКыргыз тилиҚазақшаCatalàCorsaLatviešuHausaગુજરાતીಕನ್ನಡkannaḍaमराठी

Что такое NPU и как он работает в устройствах искусственного интеллекта?

Каталог

Что такое НПУ?

Нейронный процессор (NPU) — это специализированный процессор, предназначенный для более эффективного решения задач искусственного интеллекта, чем процессор общего назначения.Его основная роль — ускорить операции нейронной сети, используемые в таких функциях, как распознавание изображений, обработка голоса, обнаружение объектов и вывод искусственного интеллекта в реальном времени.В отличие от центрального процессора, который создан для выполнения множества различных вычислительных задач, NPU ориентирован на вычисления, связанные с искусственным интеллектом.Он оптимизирован для одновременной обработки больших объемов данных, что делает его пригодным для рабочих нагрузок, требующих быстрого распознавания образов и принятия решений.В современных устройствах NPU помогают функциям искусственного интеллекта работать непосредственно на локальном оборудовании, а не полностью зависеть от облачных серверов.Это позволяет смартфонам, интеллектуальным камерам, роботам, транспортным средствам и периферийным устройствам реагировать быстрее, потребляя при этом меньше энергии.Благодаря этому NPU стали важной частью современных интеллектуальных систем.

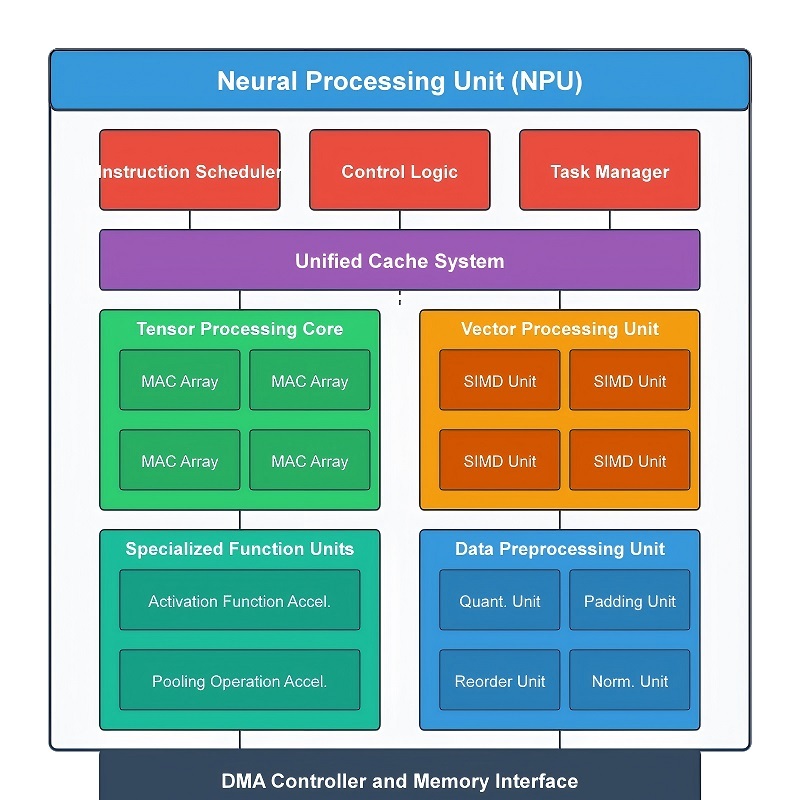

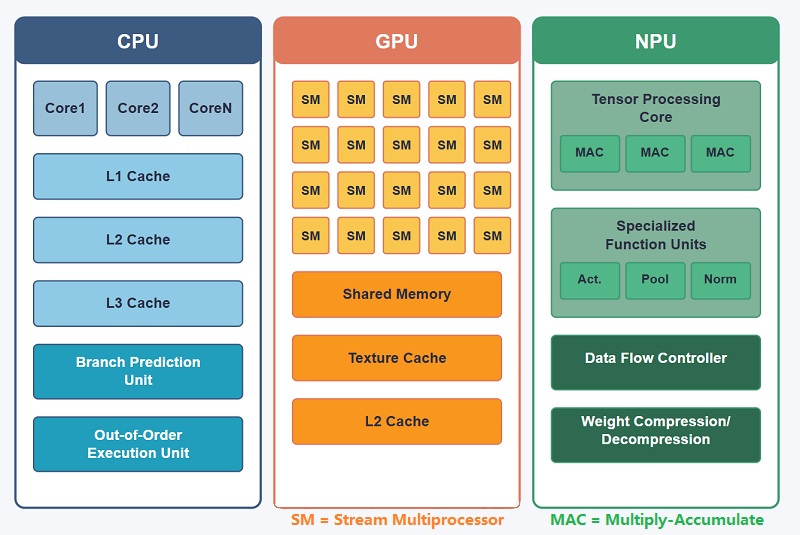

Базовая архитектура и модули обработки NPU

NPU состоит из нескольких специализированных аппаратных модулей, которые работают вместе для быстрой и эффективной обработки рабочих нагрузок нейронной сети.Вместо того, чтобы отправлять каждую операцию через один процессор общего назначения, рабочая нагрузка распределяется по выделенным аппаратным блокам, которые непрерывно обрабатывают данные параллельно.Эта структура повышает скорость вывода ИИ, уменьшает ненужное перемещение данных, снижает энергопотребление и помогает поддерживать эффективное использование памяти.

Во время обработки ИИ данные проходят через несколько этапов внутри процессора.Входные данные сначала поступают в вычислительный конвейер, где выполняются масштабные математические операции.Затем промежуточные результаты проходят через обработку активации, тензорное ускорение, операции, связанные с изображениями, и аппаратную оптимизацию памяти, прежде чем будет получен окончательный результат.Поскольку эти модули работают вместе в скоординированной последовательности, NPU может поддерживать высокую пропускную способность даже при запуске больших моделей нейронных сетей.

Основные вычислительные модули и модули активации

Основным вычислительным механизмом внутри NPU является блок умножения-накопления (MAC).Большинство рабочих нагрузок нейронных сетей неоднократно выполняют умножение и сложение очень больших наборов данных, поэтому это оборудование выполняет большую часть вычислений ИИ во время вывода.Когда входные данные поступают в нейронную сеть, значения умножаются на сохраненные значения веса, а затем складываются для генерации новых выходных данных.Этот процесс непрерывно повторяется на многих уровнях нейронной сети.

Современные NPU часто содержат сотни или тысячи блоков MAC, работающих одновременно.Вместо расчета одной операции за раз аппаратное обеспечение распределяет рабочие нагрузки по множеству параллельных путей выполнения.Большие пакеты данных ИИ проходят через процессор вместе, что значительно повышает скорость вывода при сохранении низкой задержки.Например, в системах распознавания изображений блоки MAC неоднократно сканируют группы пикселей и комбинируют значения фильтров для обнаружения краев, текстур, форм и узоров.В языковых моделях одно и то же оборудование выполняет крупномасштабные векторные и матричные операции для обработки токенов и связей между словами.

После завершения этих математических расчетов результаты переносятся в модуль «Функция активации».Нейронные сети зависят от нелинейных функций активации для обработки сложных взаимосвязей внутри данных.Без обработки активации сеть будет выполнять только простые линейные вычисления и не сможет эффективно решать сложные задачи ИИ.

Этот модуль выполняет такие функции, как ReLU, Sigmoid и Tanh, непосредственно на аппаратном уровне.Входящие значения быстро трансформируются согласно выбранному правилу активации.ReLU, например, удаляет отрицательные значения, сохраняя при этом положительные выходные данные, помогая сети сосредоточиться на более сильных признаках сигналов во время вывода.Поскольку обработка активации происходит неоднократно на каждом уровне нейронной сети, специальное оборудование для ускорения помогает сократить задержки и предотвращает перегрузку основных вычислительных блоков.

Модули тензорной и пространственной обработки данных

NPU также включают в себя специализированное оборудование для обработки тензорных операций и обработки пространственных данных.Почти каждая современная модель ИИ опирается на тензоры — многомерные структуры данных, используемые для организации информации по таким измерениям, как ширина, высота, каналы, векторные слои и пакеты.Большие объемы тензорных данных постоянно перемещаются между слоями нейронной сети во время вывода.

Модуль тензорного ускорения обрабатывает эти тензорные структуры непосредственно на аппаратном уровне.Такие операции, как тензорное умножение, изменение формы, преобразование и накопление, выполняются намного быстрее, чем на процессорах общего назначения.Такое специальное ускорение становится особенно важным в трансформаторных архитектурах, системах компьютерного зрения, больших языковых моделях и приложениях искусственного интеллекта реального времени, требующих очень высокой пропускной способности.

Помимо тензорной обработки, NPU также содержат модули, предназначенные для операций с 2D и пространственными данными, обычно используемых в рабочих нагрузках с изображениями и видео.Системы компьютерного зрения постоянно изменяют размер, реорганизуют, фильтруют и перемещают большие объемы пиксельных данных, прежде чем начнется более глубокий анализ ИИ.Раздельное выполнение этих задач повышает эффективность и снижает нагрузку на основной вычислительный механизм.

Во время обработки изображений аппаратное обеспечение управляет такими операциями, как понижение разрешения, перемещение карты объектов, копирование изображения, изменение размера, обрезка и передача пространственных данных.Например, видео высокого разрешения, снятое камерой, можно сначала изменить в размере и реорганизовать, прежде чем оно попадет в конвейер нейронной сети.Это снижает вычислительную нагрузку, сохраняя при этом важную визуальную информацию, необходимую для обнаружения объектов и анализа сцены.

Модули оптимизации памяти и сжатия данных

Современные модели искусственного интеллекта требуют большого объема памяти для хранения весов нейронной сети, тензоров и промежуточных данных.Постоянная передача этой информации между памятью и вычислительным оборудованием увеличивает использование полосы пропускания, задержку и энергопотребление.Чтобы уменьшить эти накладные расходы, NPU включают в себя специальные модули сжатия и распаковки данных.

Прежде чем данные будут сохранены в памяти, повторяющиеся шаблоны и значения веса сжимаются в меньшие форматы.В ходе выполнения сжатая информация быстро восстанавливается и отправляется непосредственно в вычислительный конвейер.Это уменьшает трафик памяти и позволяет большему количеству данных AI оставаться в высокоскоростной локальной памяти ближе к процессору.

Расширенные методы сжатия часто позволяют уменьшить размер модели в несколько раз, сохраняя при этом почти ту же точность вывода.Это становится особенно важным в смартфонах, встроенных системах, интеллектуальных камерах, носимой электронике и других периферийных устройствах с искусственным интеллектом, где объем памяти и энергоэффективность ограничены.

Как эти модули работают вместе

Производительность NPU не зависит от одного аппаратного блока.Его эффективность достигается за счет того, что все модули обработки работают вместе как скоординированный конвейер.

Типичная рабочая нагрузка ИИ начинается с крупномасштабных математических вычислений внутри блоков MAC.Промежуточные результаты затем проходят обработку активации, чтобы привнести нелинейное поведение в нейронную сеть.Аппаратное обеспечение тензорного ускорения непрерывно организует и обрабатывает многомерные данные по всему конвейеру, а модули пространственной обработки управляют операциями, связанными с изображениями и видео.В то же время аппаратное обеспечение сжатия снижает накладные расходы на передачу памяти в фоновом режиме.

Поскольку эти операции выполняются одновременно по выделенным аппаратным путям, NPU может обрабатывать большие рабочие нагрузки ИИ с высокой пропускной способностью, меньшей задержкой и гораздо большей энергоэффективностью, чем традиционные процессоры.

NPU в смартфонах и мобильном искусственном интеллекте

Современные смартфоны каждую секунду выполняют огромное количество операций.Телефон может разблокироваться с помощью распознавания лиц, открывать камеру, обрабатывать фотографии, переводить речь и практически мгновенно запускать приложения с помощью искусственного интеллекта.Чтобы поддерживать этот уровень производительности в тонких мобильных устройствах с ограниченной емкостью аккумулятора, смартфоны используют высокоинтегрированную архитектуру System-on-Chip (SoC).

Внутри SoC несколько процессоров работают вместе, и каждый процессор оптимизирован для различной рабочей нагрузки.ЦП управляет системой управления, приложениями и общими вычислительными задачами.Графический процессор отвечает за рендеринг графики, игры и визуальную обработку.NPU (нейронный процессор) специализируется конкретно на вычислениях с использованием искусственного интеллекта.

Вместо маршрутизации рабочих нагрузок нейронной сети через ЦП или графический процессор смартфоны направляют многие задачи ИИ на NPU, где оборудование оптимизировано для быстрой параллельной обработки ИИ.Такое разделение повышает эффективность, поскольку каждый процессор обрабатывает тот тип рабочей нагрузки, для которого он был разработан.В результате смартфоны могут выполнять расширенные операции искусственного интеллекта с более быстрым временем отклика, меньшей задержкой и большей энергоэффективностью.

Как NPU изменили ИИ в смартфонах

До того, как мобильные NPU стали обычным явлением, многие функции искусственного интеллекта смартфонов сильно зависели от облачных вычислений.Такие задачи, как распознавание голоса, языковой перевод, улучшение изображений и интеллектуальные помощники, часто требовали загрузки данных на удаленные серверы для обработки, прежде чем результаты будут возвращены на устройство.Это привело к задержкам, увеличению сетевого трафика и вызвало проблемы конфиденциальности.

Внедрение выделенных мобильных NPU существенно изменило этот рабочий процесс.Модели искусственного интеллекта теперь могут запускаться непосредственно на самом смартфоне, что позволяет выполнять многие операции локально в режиме реального времени, а не полностью зависеть от внешних серверов.

Этот сдвиг дал несколько важных преимуществ:

• Меньшая задержка, поскольку данным больше не требуется постоянная связь с облаком.

• Более быстрое время отклика ИИ при операциях в реальном времени.

• Лучшая защита конфиденциальности, поскольку конфиденциальные данные могут оставаться на устройстве.

• Снижение энергопотребления благодаря оборудованию, оптимизированному специально для рабочих нагрузок искусственного интеллекта.

• Более стабильная работа искусственного интеллекта даже при слабом или недоступном подключении к Интернету.

По мере того как мобильные NPU становились более мощными, смартфоны начали постоянно запускать расширенные функции искусственного интеллекта в фоновом режиме без заметных задержек при ежедневном использовании.

Как смартфоны используют NPU в реальных операциях

AI-фотография и обработка изображений

Одним из наиболее заметных применений мобильных NPU является фотография с использованием искусственного интеллекта.Современные камеры смартфонов больше не полагаются только на датчики изображения и традиционные алгоритмы обработки изображений.Модели искусственного интеллекта теперь непрерывно анализируют данные изображения во время работы камеры.

Когда открывается приложение камеры, смартфон сразу же начинает кадр за кадром обрабатывать входящий поток изображений.NPU анализирует условия освещения, границы объектов, детали лица, цвета, текстуры и модели движения в режиме реального времени.На основе этого анализа система регулирует экспозицию, баланс белого, настройки HDR, резкость и контраст почти мгновенно перед съемкой изображения.

При съемке при слабом освещении NPU объединяет несколько кадров изображения, чтобы повысить яркость и снизить визуальный шум.Во время портретной фотографии процессор отделяет объекты на переднем плане от областей фона и более точно применяет эффекты глубины к краям, таким как волосы, очки и контуры одежды.

Распознавание сцены также сильно зависит от NPU.Процессор сравнивает шаблоны изображений с обученными моделями искусственного интеллекта, чтобы идентифицировать такие среды, как еда, пейзажи, домашние животные, документы, закаты или ночные сцены.После распознавания камера автоматически настраивает параметры для оптимизации качества изображения.

Поскольку эти вычисления происходят непосредственно на смартфоне, фотография с использованием ИИ кажется почти мгновенной, даже несмотря на то, что большие объемы вычислений нейронной сети постоянно происходят в фоновом режиме.

Распознавание голоса и помощники искусственного интеллекта

Голосовые помощники и функции, связанные с речью, также в значительной степени полагаются на локальное ускорение искусственного интеллекта.Когда пользователь разговаривает со смартфоном, микрофон улавливает необработанные аудиосигналы, которые необходимо очистить, разделить и преобразовать в распознаваемые речевые образцы.

NPU непрерывно обрабатывает аудиопоток, определяя фонемы, фильтруя фоновый шум и сопоставляя звуковые шаблоны с моделями распознавания речи.Локальная обработка ИИ позволяет практически мгновенно обнаруживать слова пробуждения и общие голосовые команды без постоянной передачи аудиозаписей на облачные серверы.

Это улучшает скорость реагирования на такие задачи, как:

• Голосовые команды

• Транскрипция речи в реальном времени.

• Языковой перевод

• Взаимодействие с искусственным интеллектом

• Улучшение вызовов с помощью искусственного интеллекта

• Подавление шума во время видеовызовов.

Поскольку большая часть обработки происходит непосредственно на устройстве, голосовое взаимодействие остается более плавным даже в нестабильных условиях сети.

ИИ-игры и оптимизация системы в реальном времени

Современные смартфоны также используют NPU для оптимизации игр и интеллектуального управления системой.Во время игры модели искусственного интеллекта отслеживают требования к рендерингу кадров, поведение рабочей нагрузки, температурные условия, шаблоны сенсорного ввода и использование батареи в режиме реального времени.

Система может динамически регулировать рабочую нагрузку графического процессора, оптимизировать распределение мощности, стабилизировать частоту кадров и снижать перегрев во время длительных игровых сессий.Некоторые смартфоны также используют методы масштабирования искусственного интеллекта и прогнозирования движения для улучшения визуальной плавности при сохранении более низкого энергопотребления.

Вне игр NPU помогает оптимизировать фоновые приложения, управление зарядом батареи, прогнозирование взаимодействия с пользователем и планирование задач на основе моделей использования устройства.

Эволюция мобильных NPU

Разработка мобильных NPU быстро ускорилась, поскольку рабочие нагрузки искусственного интеллекта на смартфонах стали более сложными и требовательными к вычислительным ресурсам.

|

Период |

Разработка мобильных НПУ |

|

2017 — Первые коммерческие мобильные NPU |

Huawei представила один из первых коммерческих смартфонов

NPU через процессор Kirin 970.Это ознаменовало серьезный сдвиг в сторону

масштабное ускорение искусственного интеллекта внутри потребительских смартфонов.Вместо

полагаясь в основном на центральные и графические процессоры для задач искусственного интеллекта, теперь в него входят смартфоны

специальное оборудование искусственного интеллекта непосредственно внутри архитектуры SoC. |

|

2018 — Расширение возможностей искусственного интеллекта на устройстве |

Apple представила Neural Engine внутри A12 Bionic

чип, улучшающий обработку ИИ для распознавания лиц, вычислительные

фотография и интеллектуальные мобильные функции.Искусственный интеллект на устройствах стал основным

сосредоточиться на разработке флагманских смартфонов. |

|

2019–2020 — Общеотраслевая интеграция искусственного интеллекта |

Крупнейшие производители чипов, включая Qualcomm, Samsung и

MediaTek начала интеграцию специализированных ускорителей искусственного интеллекта во флагманские мобильные устройства

процессоры.Производительность ИИ стала основным конкурентным фактором в

аппаратный дизайн смартфона. |

|

2021–2023 гг. — обработка ИИ становится основным ориентиром |

Производители смартфонов все чаще сравнивают NPU

производительность наряду с производительностью процессора и графического процессора.НПУ стали центральными

вычислительная фотография, голосовой искусственный интеллект, улучшение видео, оптимизация батареи,

и интеллектуальные функции системы. |

|

2024–2025 гг. — Крупные модели искусственного интеллекта, работающие на смартфонах. |

Современные мобильные NPU получили достаточную вычислительную мощность, чтобы

поддержка более крупных моделей искусственного интеллекта непосредственно на смартфонах и периферийных устройствах.Больше ИИ

рабочие нагрузки теперь могут выполняться локально, не сильно завися от облака

инфраструктуры, улучшая как оперативность, так и конфиденциальность. |

Сравнение текущих основных мобильных процессоров NPU

Современные флагманские процессоры для смартфонов теперь включают в себя передовую архитектуру NPU, оптимизированную для вывода данных искусственного интеллекта в реальном времени, высокую пропускную способность и повышенную энергоэффективность.

|

Мобильный процессор |

Особенности НПУ |

|

Яблоко А17 Про |

Включает 26-ядерный нейронный движок, предназначенный для быстрого

обработка ИИ на устройстве.Архитектура улучшает AI-фотографии и голос

распознавание и интеллектуальные системные функции в режиме реального времени на устройствах Apple. |

|

Qualcomm Snapdragon 8 3-го поколения |

Использует обновленный процессор Hexagon AI, оптимизированный для

генеративный искусственный интеллект, ускорение нейронных сетей, расширенная обработка изображений и

эффективные рабочие нагрузки мобильного ИИ. |

|

Медиатек размерность 9300 |

Включает APU шестого поколения (блок обработки искусственного интеллекта) с

значительные улучшения в скорости вывода ИИ и обработке ИИ в реальном времени.

возможности для смартфонов и периферийных устройств. |

|

Самсунг Эксинос 2400 |

Имеет мобильный NPU нового поколения, ориентированный на более быструю работу.

обработка искусственного интеллекта на устройстве для компьютерной фотографии, интеллектуальная система

операции и передовые мобильные приложения искусственного интеллекта. |

NPU, GPU и CPU: ключевые различия в обработке ИИ

И графические процессоры, и NPU предназначены для параллельной обработки больших объемов данных, но они созданы для совершенно разных целей.Изначально графический процессор был разработан для рендеринга графики, а NPU был создан специально для вычислений нейронных сетей и вывода ИИ. Из-за разницы в целях проектирования два процессора по-разному справляются с рабочими нагрузками ИИ.Графические процессоры могут эффективно запускать модели ИИ, особенно в крупномасштабных системах обучения, но они по-прежнему несут в себе большую часть сложности графического процессора.NPU упрощают многие из этих операций, почти полностью сосредотачиваясь на вычислениях, связанных с искусственным интеллектом.

|

Особенность |

ЦП

(Центральный процессор) |

графический процессор

(Графический процессор) |

НПУ

(Блок нейронной обработки) |

|

Основная цель |

общего назначения

вычисления и управление системами |

Параллельно

графика и высокопроизводительные вычисления |

Выводы ИИ и

ускорение нейронной сети |

|

Основная рабочая нагрузка |

Операционная

системы, приложения, многозадачность |

Графика

рендеринг, обучение искусственному интеллекту, научные вычисления |

обработка ИИ,

тензорные операции, вывод глубокого обучения |

|

Стиль обработки |

Последовательный

обработка |

Массивная параллель

обработка |

Оптимизированный для искусственного интеллекта

параллельная обработка |

|

Основной дизайн |

Мало мощных и

гибкие сердечники |

Тысячи

Ядра параллельного выполнения |

Специализированный ИИ

единицы ускорения |

|

Производительность ИИ |

Умеренный |

Высокий |

Очень высокий для ИИ

вывод |

|

Матрица

Скорость умножения |

Ограниченный |

Быстро |

Высокая оптимизация |

|

Тензор

Обработка |

Программное обеспечение |

Поддерживается

за счет ускорения графического процессора |

Выделенный тензор

аппаратное ускорение |

|

Энергоэффективность |

Ниже для ИИ

рабочие нагрузки |

От умеренного до высокого

энергопотребление |

Высокая мощность

эффективный |

|

Выработка тепла |

Умеренный |

Высокий под тяжелым

рабочие нагрузки |

Ниже во время AI

вывод |

|

Пропускная способность памяти

Использование |

Умеренный |

Очень высокий |

Оптимизированный и

уменьшенный |

|

Задержка в ИИ

Задачи |

Высшее |

Умеренный |

Очень низкий |

|

ИИ в реальном времени

Возможность |

Ограниченный |

Хорошо |

Отлично |

|

Лучшее для ИИ

Обучение |

Не идеально |

Отлично |

Ограничено по сравнению

к графическим процессорам |

|

Лучшее для ИИ

Вывод |

Основные рабочие нагрузки |

Высокая производительность

вывод |

Оптимизированный

вывод в реальном времени |

|

Общий

Приложения |

ПК, серверы,

операционные системы |

Игры, ИИ

обучение, рендеринг, симуляции |

Смартфоны,

Edge AI, робототехника, умные камеры |

|

Зависимость от

Облачный ИИ |

Высшее |

Умеренный |

Ниже из-за

локальное ускорение ИИ |

|

Батарея

Эффективность мобильных устройств |

Нижний |

Умеренный |

Высокий |

|

Типовые устройства |

Компьютеры,

ноутбуки, серверы |

Игровые ПК, ИИ

серверы, рабочие станции |

Смартфоны, Интернет вещей

устройства, периферийное оборудование искусственного интеллекта |

|

Стоимость и

Сложность |

общего назначения

архитектура |

Комплекс

высокопроизводительная архитектура |

Специализированный

Архитектура, ориентированная на искусственный интеллект |

|

Основное преимущество |

Гибкость и

управление системой |

Масштабный

параллельные вычисления |

Быстро и

эффективная локальная обработка ИИ |

Специализированные процессоры в современных вычислениях

Помимо NPU, современные вычислительные системы используют множество различных типов процессоров, поскольку ни одна архитектура не может эффективно обрабатывать каждую рабочую нагрузку.Некоторые процессоры ориентированы на управление системой, некоторые специализируются на рендеринге графики, а другие оптимизированы для ускорения искусственного интеллекта, работы в сети, научных вычислений или встроенного управления.

Внутри современных смартфонов, серверов, промышленных систем, робототехнических платформ, транспортных средств и периферийных устройств искусственного интеллекта часто одновременно работают несколько процессоров.Каждый процессор обрабатывает тот тип рабочей нагрузки, для которого он был специально разработан, повышая производительность, энергоэффективность и скорость реагирования в реальном времени в современных вычислительных средах.

ЦП: Центральный процессор

ЦП (центральный процессор) является основным контроллером большинства вычислительных систем.Он управляет операционными системами, приложениями, координацией памяти, планированием задач и связью между аппаратными компонентами.

Процессоры очень гибки и могут надежно обрабатывать множество различных рабочих нагрузок, что делает их незаменимыми в компьютерах, смартфонах, серверах и встроенных системах.Однако они менее эффективны для крупномасштабных параллельных рабочих нагрузок ИИ по сравнению с более специализированными процессорами.

Графический процессор: графический процессор

Графический процессор (GPU) оптимизирован для крупномасштабной параллельной обработки.Архитектура содержит множество исполнительных ядер, способных одновременно обрабатывать тысячи операций.

Первоначально графические процессоры были разработаны для рендеринга графики, но теперь они широко используются для обучения искусственного интеллекта, научного моделирования, обработки видео и высокопроизводительных вычислений из-за их мощных возможностей параллельных вычислений.

ТПУ: Тензорный процессор

TPU (тензорный процессор) оптимизирован для рабочих нагрузок искусственного интеллекта на основе тензоров и крупномасштабного ускорения глубокого обучения.Эти процессоры предназначены в основном для облачной инфраструктуры искусственного интеллекта и сред машинного обучения в центрах обработки данных.

ТПУ высокоэффективны для:

• Обучение глубокому обучению

• Большие модели искусственного интеллекта

• Тензорные вычисления

• Облачные услуги искусственного интеллекта.

• Высокопроизводительное ускорение искусственного интеллекта.

FPGA: реконфигурируемая аппаратная обработка

FPGA (программируемая пользователем вентильная матрица) использует программируемые логические блоки, которые можно настроить для конкретных задач после производства.В отличие от архитектур с фиксированным процессором, FPGA позволяют настраивать саму аппаратную функцию.

FPGA широко используются в:

• Системы связи

• Автомобильная электроника

• Промышленная автоматизация

• Аэрокосмические системы

• Периферийные вычисления

• Медицинское оборудование

ДПУ: Блок обработки данных

DPU (блок обработки данных) оптимизирован для рабочих нагрузок, ориентированных на данные, внутри облачной инфраструктуры и сетевых систем.DPU помогают снизить нагрузку на ЦП за счет ускорения перемещения данных, операций хранения, шифрования и управления сетевым трафиком.

Эти процессоры обычно используются в:

• Центры обработки данных

• Облачные вычисления

• Высокоскоростная сеть

• Ускорение хранения данных

• Серверная инфраструктура

VPU: блок обработки изображений

VPU (блок обработки изображений) специализируется на компьютерном зрении и обработке изображений на основе искусственного интеллекта.VPU ускоряют такие рабочие нагрузки, как распознавание лиц, обнаружение объектов, отслеживание движения и анализ видео.

VPU обычно встречаются в:

• Умные камеры

• Системы наблюдения

• Робототехника

• Автономные транспортные средства

• Системы дополненной и виртуальной реальности

• Устройства машинного зрения Edge AI

IPU: Блок обработки разведывательных данных

IPU (Intelligence Processing Unit) предназначен для высокопараллельных рабочих нагрузок искусственного интеллекта и машинного обучения.Архитектура ориентирована на повышение эффективности потока данных во время крупномасштабного выполнения нейронной сети.

IPU используются для:

• Ускорение машинного обучения

• Распознавание образов

• Выводы ИИ

• Параллельная тензорная обработка

• Передовые исследования в области искусственного интеллекта

BPU: блок обработки мозга

BPU (мозговой процессор) оптимизирован для встроенных систем искусственного интеллекта и периферийных интеллектуальных систем.Эти процессоры ориентированы на быстрый локальный вывод искусственного интеллекта с меньшим энергопотреблением.

BPU обычно используются в:

• Интеллектуальные сенсорные системы

• Робототехника

• Аппаратное обеспечение Edge AI

• Системы обнаружения движения

• Автономные платформы

HPU: Голографический процессор

HPU (голографический процессор) предназначен для голографических вычислений, смешанной реальности и систем пространственного анализа.

HPU помогают обрабатывать:

• Экологическое картографирование

• Отслеживание движения

• Слияние датчиков

• Пространственное взаимодействие в реальном времени

• Среды AR/VR

MPU и MCU: встроенная обработка управления

MPU (микропроцессорные блоки) и MCU (микроконтроллерные блоки) широко используются во встроенных системах и маломощной электронике.

MPU обычно используются во встроенных вычислительных системах, требующих управления на уровне операционной системы, в то время как MCU интегрируют ядра процессора, память и управление вводом/выводом в компактный чип для специализированных задач с низким энергопотреблением.

Эти процессоры обычно встречаются в:

• устройства Интернета вещей

• Промышленные контроллеры

• Автомобильная электроника

• Бытовая техника

• Портативные встраиваемые системы

APU: блок ускоренной обработки

APU (ускоренный процессор) сочетает в себе функциональность центрального и графического процессоров в одном процессорном корпусе.Эта интеграция повышает энергоэффективность, уменьшает размер оборудования и позволяет вычислительным и графическим нагрузкам более эффективно распределять системные ресурсы.

APU обычно используются в:

• Ноутбуки

• Мини-ПК

• Игровые системы начального уровня

• Мультимедийные устройства

• Портативные вычислительные платформы

Почему современные системы используют несколько специализированных процессоров

Современные вычислительные системы редко полагаются на однопроцессорную архитектуру.Вместо этого устройства объединяют несколько специализированных процессоров, поскольку разные рабочие нагрузки требуют разных методов обработки.

Например, современная система может использовать:

• Процессоры для управления системой

• Графические процессоры для графики и параллельных вычислений.

• NPU для вывода ИИ

• Графические процессоры для компьютерного зрения

• DPU для работы в сети и перемещения данных.

• Микроконтроллеры для встроенных задач управления

Распределяя рабочие нагрузки по выделенному оборудованию, современные системы обеспечивают более высокую производительность, меньшую задержку, повышенную энергоэффективность и более эффективную обработку в реальном времени в средах искусственного интеллекта, графики, сетевых и встроенных вычислений.

Заключение

NPU становятся незаменимыми в современных вычислениях, поскольку они позволяют задачам ИИ выполняться локально, быстро и эффективно, не сильно завися от облачных вычислений.Их оптимизированная архитектура снижает задержку, энергопотребление, движение памяти и выделение тепла, что делает их ценными в смартфонах, робототехнике, устройствах здравоохранения, промышленной автоматизации, умных домах, автономных системах и периферийных платформах искусственного интеллекта.По мере того, как модели ИИ становятся больше и сложнее, будущие NPU будут продолжать совершенствоваться за счет более умных архитектур, вычислений низкой точности, обработки в памяти, поддержки локальных больших моделей, усовершенствованного дизайна полупроводников и более надежных функций безопасности ИИ.

Часто задаваемые вопросы [FAQ]

1. Почему NPU более эффективны, чем CPU, для рабочих нагрузок нейронных сетей?

NPU более эффективны, поскольку их оборудование разработано специально для вычислений ИИ, а не для обработки общего назначения.ЦП последовательно обрабатывает множество различных системных задач, тогда как NPU фокусируется в основном на тензорных операциях, умножении матриц, свертке и параллельной обработке нейронных сетей.Это позволяет NPU быстрее выполнять выводы ИИ, потребляя при этом меньше энергии и выделяя меньше тепла.

2. Как параллельная обработка повышает производительность NPU во время вывода ИИ?

NPU делят рабочие нагрузки ИИ на множество более мелких операций, которые выполняются одновременно на нескольких вычислительных устройствах.Вместо того, чтобы ждать завершения одной инструкции перед запуском другой, большие объемы данных нейронной сети проходят через процессор параллельно.Это значительно повышает пропускную способность и снижает задержку во время таких рабочих нагрузок, как распознавание изображений, обработка речи и обнаружение объектов в реальном времени.

3. Почему в современных ЯПУ важны вычисления низкой точности?

Многие модели искусственного интеллекта не требуют чрезвычайно высокой числовой точности для получения точных результатов.NPU используют такие форматы, как INT8 и FP16, для уменьшения использования памяти и вычислительных затрат.Обработка с более низкой точностью позволяет выполнять больше операций за меньшее время, одновременно повышая энергоэффективность и сохраняя высокую производительность вывода ИИ.

4. Как NPU уменьшают узкие места при передаче памяти по сравнению с графическими процессорами?

NPU размещают память и вычислительное оборудование ближе друг к другу внутри архитектуры процессора.Вместо многократной передачи больших объемов тензорных данных между внешней памятью и ядрами обработки многие промежуточные операции остаются рядом с исполнительными устройствами.Это сокращает пути передачи данных, снижает использование полосы пропускания, снижает задержку и повышает общую энергоэффективность.

5. Почему NPU становятся полезными в смартфонах и периферийных устройствах с искусственным интеллектом?

Современные устройства требуют быстрой локальной обработки ИИ с низким энергопотреблением и минимальной задержкой.NPU позволяют смартфонам и периферийным системам выполнять задачи искусственного интеллекта, такие как распознавание лиц, фотографии с использованием искусственного интеллекта, голосовое взаимодействие и обнаружение объектов, непосредственно на устройстве, без сильной зависимости от облачных серверов.Это улучшает скорость реагирования, конфиденциальность и эффективность использования батареи.

6. Как модули MAC способствуют ускорению NPU?

Блоки умножения-накопления (MAC) обрабатывают повторяющиеся операции умножения и сложения, используемые в нейронных сетях.Современные NPU содержат сотни или тысячи блоков MAC, работающих одновременно, что позволяет обрабатывать большие рабочие нагрузки ИИ намного быстрее, чем на традиционных последовательных процессорах.

7. Почему современные системы искусственного интеллекта используют как графические процессоры, так и NPU, а не полагаются на один тип процессора?

Графические процессоры и NPU оптимизированы для различных рабочих нагрузок.Графические процессоры превосходно справляются с крупномасштабным обучением искусственного интеллекта, рендерингом графики и высокопроизводительными параллельными вычислениями, а NPU оптимизированы для маломощного вывода искусственного интеллекта и локальной обработки в реальном времени.Совместное использование обоих процессоров позволяет системам сбалансировать гибкость, производительность и энергоэффективность.

8. Как NPU улучшают обработку ИИ в реальном времени в робототехнике и автономных системах?

Робототехника и автономные системы непрерывно обрабатывают входные данные камеры, картографирование окружающей среды, данные датчиков и анализ движения.NPU ускоряют эти рабочие нагрузки локально с низкой задержкой, позволяя системам быстро реагировать во время навигации, обнаружения препятствий, распознавания пешеходов и принятия решений в реальном времени.

9. Почему ИИ на устройстве становится все более важным для будущего развития NPU?

Искусственный интеллект на устройстве снижает зависимость от облачных вычислений, позволяя моделям искусственного интеллекта работать непосредственно на локальном оборудовании.Это повышает конфиденциальность, снижает использование полосы пропускания сети и обеспечивает более быструю реакцию в режиме реального времени.Ожидается, что будущие NPU будут поддерживать более крупные локальные модели искусственного интеллекта, мультимодальную обработку искусственного интеллекта и расширенные рабочие нагрузки генеративного искусственного интеллекта непосредственно внутри потребительских и промышленных устройств.

10. Как будущие архитектуры NPU могут изменить эффективность аппаратного обеспечения ИИ?

Будущие NPU, вероятно, будут использовать более разумное распределение рабочей нагрузки, разреженные вычисления, обработку в памяти, архитектуру чиплетов и адаптивное точное управление для повышения эффективности.Эти технологии направлены на сокращение ненужных вычислений, снижение энергопотребления и увеличение пропускной способности, а также поддержку более крупных и продвинутых моделей искусственного интеллекта в периферийных устройствах, робототехнике, промышленных системах и интеллектуальной бытовой электронике.

Связанный блог

-

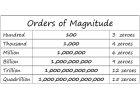

Сколько нулей за миллион миллиардов, триллион?

2024/07/29

Миллион представляет 106, легко захватываемая фигура по сравнению с повседневными ... -

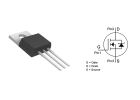

IRLZ44N MOSFET DASHASHIT, Схема, эквивалент, распина

2024/08/28

IRLZ44N является широко используемым N-канальным мощным MOSFET.Известный своими превосх... -

Температура батареи слишком низкая, зарядка остановилась.Как это исправить?

2024/10/6

Проблемы зарядки батареи мобильного телефона являются обычными, но могут эффекти... -

BC547

2024/07/4

Транзистор BC547 обычно используется в различных электронных приложениях, от основ... -

Комплексное руководство по SCR (выпрямитель с управлением кремния)

2024/04/22

Кремниевые рецидивы (SCR) или тиристоры играют ключевую роль в технологии электрон... -

LR621, SR621SW, 364, эквиваленты батареи и замены батареи AG1

2024/07/15

Батареи кнопок LR621 и SR621SW распространены в компактных электронных устройствах, та... -

Основы схем Op-AMP

2023/12/28

В запутанном мире электроники путешествие в свои загадки неизменно приводит нас ... -

Сравнение различий и приложений NMOS и PMOS

2024/11/15

Понимание различий между NMO и транзисторами PMOS важно при разработке эффективных ц... -

Полное руководство по мультиплексорам и их роль в цифровых системах

2025/09/20

Мультиплекторы представляют собой компоненты в цифровых системах, предназначенн... -

Что означают std, agm и gel на зарядном устройстве аккумулятора

2024/07/10

Традиционные зарядные устройства для батареи в свинцовой кислоте известны своей ...

Горячие части

- TEA1762T/N2/DG

- GC5016-PB

- GNS1101M-250FP208-AD00-G

- UAA3519AHL

- C1005NP01H150J050BA

- M29F400B-120N1

- TAP226K025GSB

- GRM1885C1H5R7DA01D

- DLW5BSM191SQ2L

- MM74HC4040M

- DG411DY

- BD62012FS-E2

- MI-J22-IY-03

- SN74LVC1G98YEAR

- XC3S1500-4FG320I

- ADP151ACPZ-3.0-R7

- CY7C1367C-166AXC

- CXD9665Q

- MPA702-1-VOB

- TC7WH08FU

- HMC447LC3TR

- 12065C102M4T2A

- S29GL064N90TFI030

- HD64F39079LFZV

- PIC18F24K20T-I/SO

- SI3018-F-FT

- GRM1555C1H121GA01D

- T491A475M020AT

- T495X337M006ATE100

- UPD780023AGK

- GCM3195C1H183JA16D

- 74ACT373SJX

- VI-J64-MX

- T491C156K010AT4280

- VE-J71-CX

- T491X476M025AT7280

- ASM1153

- LC75711NED

- MAX9324EUP

- MAX31855KASA

- TA599480AB

- AMBASSADOR-T-8105-BAL4

- MAX1062BCUB

- STC89C51RC-40I-PLCC44

- TMS320TCI6486CGTZ

- HD6417034BVFN20V

- ZX234220A1

- BC846.215

- MBI5045GP-A

- BCM53162XMB1ILFBG